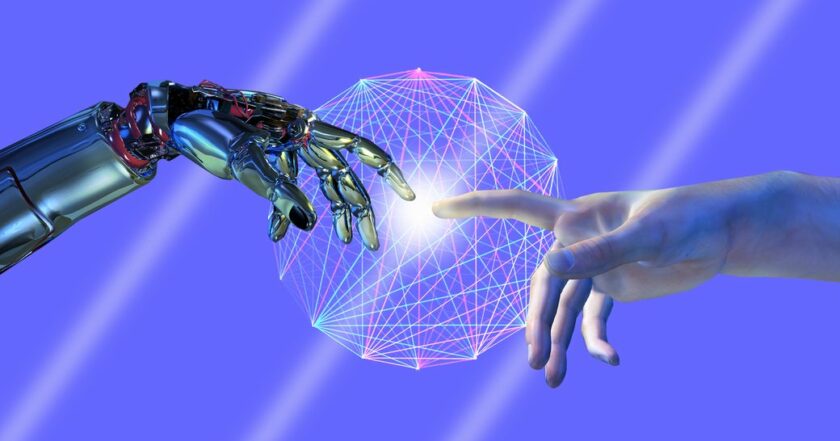

OpenAI, Alphabet и еще пять компаний пообещали Байдену ставить водяные знаки на контент, созданный искусственным интеллектом

Семь компаний искусственного интеллекта добровольно обязались перед Белым домом обозначать водяными знаками контент, созданный искусственным интеллектом. Это поможет сделать эту технологию более безопасной.

Об этом сообщил президент США Джо Байден 21 июля, цитирует Reuters.

Речь идет о компаниях OpenAI, Alphabet, Meta Platforms Anthropic, Inflection, Amazon.com, Microsoft. Их представители, в частности, пообещали тщательно тестировать системы перед их выпуском и делиться информацией о том, как уменьшить риски и инвестировать в кибербезопасность.

Компании также обязались разработать систему «водяных знаков» для всех форм контента: от текста, изображений, аудио до видео, созданных ИИ. Это необходимо для того, чтоб юзеры знали, когда при создании контента была использована эта разработка.

Водяной знак должен быть встроен в содержимое контента техническим способом. Вероятно, это поможет пользователям обнаруживать поддельные изображения и аудио, которые могут, например, демонстрировать насилие, которого не было. Пока не ясно, как водяной знак будет виден при обмене информацией.

Компании также пообещали сосредоточиться на защите конфиденциальности пользователей искусственного интеллекта и обеспечить, чтобы технология была свободна от предубеждений и не использовалась для дискриминации уязвимых групп.

Среди других обязательств — разработка решений искусственным интеллектом в рамках медицинских исследований и уменьшение климатических изменений.

«Эти обязательства являются многообещающим шагом, но нам нужно еще много работать вместе», — заявил Байден, который перед этим рассказывал о росте обеспокоенности на фоне потенциала использования искусственного интеллекта для разрушительных целей.

Этот шаг от семи компаний можно рассматривать как победу для администрации Байдена, которая пытается регулировать технологии искусственного интеллекта.

ИИ – опасен?

В последние месяцы несколько кибернадзорных групп опубликовали отчеты, в которых предупредили о гипотетических рисках искусственного интеллекта. Особенно быстро развиваются программы, использующие огромные объемы текста для создания убедительных диалогов, документов и т.п.

Британский национальный центр кибербезопасности ранее заявлял в своем сообщении в блоге о риске того, что преступники могут использовать ИИ для своих кибератак и выходить за пределы текущих возможностей.

На прошлой неделе один из бывших хакеров заявил, что попросил искусственный интеллект сложить убедительную попытку обманом заставить кого-то совершить денежный перевод. И ИИ написал пример электронного письма из трех абзацев с просьбой о помощи со срочным счетом-фактурой.

Если вы нашли ошибку, пожалуйста, выделите фрагмент текста и нажмите Ctrl+Enter.